AI技術が日々進化する中で、埋め込みモデルは自然言語処理やデータ分析の基盤技術として注目されています。埋め込みモデルは、複雑なテキストデータをベクトル化し、システムが情報の意味や関連性をより深く理解できるようにします。ここでは、埋め込みモデルの基本から、ファインチューニングや日本語特化の実装方法、さらに大規模言語モデル(LLM)との比較、無料で使えるモデルの紹介まで、さまざまな観点からその活用法をわかりやすく解説します。埋め込みモデルをより効果的に活用するための実践的な知識を、わかりやすくお伝えしていきます。

埋め込みモデルとは?AI時代におけるデータ処理の新常識

埋め込みモデルは、複雑なデータをベクトルという数値形式に変換し、データ同士の関連性を分析しやすくする技術です。埋め込みモデルの基本的な仕組みや応用例について解説し、ビジネスや研究での活用法を紹介します。

埋め込みモデルとは?基本概念と利用方法

埋め込みモデルとは、テキストや画像、音声などのデータを数学的なベクトル(数値の並び)として表現するモデルのことです。例えば、言葉や文章などの自然言語データを「埋め込みベクトル」に変換することで、AIや機械学習モデルがそのデータの意味や関連性を理解しやすくなります。埋め込みモデルは、検索エンジンやチャットボット、レコメンドシステムなどで活用され、ユーザーの意図や関心に応じた最適な情報を提供するのに役立ちます。

埋め込みモデルの種類

埋め込みモデルにはいくつかの種類がありますが、代表的なものを以下に紹介します。

- 単語埋め込み:単語をベクトル化し、その意味や関係性を捉える手法です。例としては、Word2VecやGloVeといったモデルがあり、単語の意味を数学的に計算することで類似性を評価することができます。

- 文書埋め込み:文章全体を1つのベクトルとして表現し、より高度な意味を扱います。これにより、文書間の関連性を把握することが可能です。BERT(Bidirectional Encoder Representations from Transformers)などが文書埋め込みに利用されます。

- 画像・音声埋め込み:画像や音声データも埋め込みモデルによりベクトル化することができ、これにより画像認識や音声認識の精度向上が図られます。

埋め込みモデルの利用方法とメリット

埋め込みモデルを活用することで、AIシステムはデータの意味や関連性を理解しやすくなり、より高度な機能を実現できます。以下は、埋め込みモデルの主なメリットと利用方法です。

- 検索エンジンの精度向上

埋め込みモデルを利用することで、従来のキーワードマッチングに比べ、検索エンジンがユーザーの意図を正確に理解し、最も関連性の高い情報を提供できます。特に、自然言語処理を用いた検索では、質問や言い回しの違いを認識して最適な結果を表示できます。 - レコメンドシステムのパーソナライズ

動画や商品、音楽のレコメンドでは、ユーザーの行動データや過去の選好に基づいて埋め込みモデルを使い、好みに合ったものを推薦します。これにより、ユーザーが求める情報やコンテンツを効率的に提供することが可能です。 - チャットボットでのユーザー対応

埋め込みモデルをチャットボットに組み込むと、ユーザーの質問の意図を理解し、適切な回答を提供しやすくなります。FAQの自動応答や、カスタマーサポートでの応答精度向上に寄与します。 - SNS分析や感情分析

埋め込みモデルは、SNSの投稿内容からユーザーの感情や意見を分析するのにも役立ちます。特定の単語やフレーズが使用される頻度や文脈をもとに、ユーザーの感情を読み取ることで、企業のマーケティング施策やブランド管理に活用されています。

埋め込みモデルの応用例

ここでは、埋め込みモデルがどのように実際の場面で活用されているかを見ていきましょう。

- Google検索

Googleの検索アルゴリズムには、埋め込みモデルが組み込まれており、ユーザーの意図に最も関連する情報を提供するよう設計されています。例えば、検索ワードが曖昧な場合でも、埋め込みモデルがその背後にある意味を解析して、適切な結果を表示します。 - 音楽ストリーミングサービス

音楽のレコメンドには、埋め込みモデルが利用されており、ユーザーが過去に聴いた楽曲やアーティストをもとに、趣味に合う楽曲を推薦します。これにより、音楽視聴の満足度が高まります。 - Eコマースサイトのレコメンド機能

Amazonや楽天などのECサイトでは、ユーザーの購買履歴や閲覧履歴を埋め込みモデルで解析し、個々のユーザーに合わせた商品を提案する機能が一般的です。これにより、購入意欲が向上し、ユーザー体験が向上します。

埋め込みモデルは、現代のデータ活用において欠かせない技術となっています。単語や文書、画像、音声などのデータを数値として表現することで、AIがその意味や関連性を理解しやすくなり、さまざまな分野での活用が進んでいます。埋め込みモデルの進化により、AIはユーザーの意図をより深く理解し、私たちの生活を豊かにするためのサービスを提供することが可能になります。

この技術は今後も進化し続け、さらに多くの業界で活用されるでしょう。

日本語の埋め込みモデル:実装方法と調整の実践ガイド

AI技術の進化に伴い、日本語に特化した埋め込みモデルのニーズが高まっています。英語とは異なる日本語の特性を正確に捉えるためには、専用のモデル実装とパラメータ調整が不可欠です。日本語埋め込みモデルの導入手順や調整方法を具体的に紹介し、実用的なガイドとして役立つ内容をお届けします。

日本語の埋め込みモデルとは?その基本と実装の重要性

埋め込みモデルは、テキストデータを数学的なベクトルに変換する技術で、AIがテキストの意味を理解できるようにします。しかし、日本語にはひらがな、カタカナ、漢字が混在するほか、敬語や語順の違いなどがあり、英語とは異なる課題があります。そのため、日本語に特化した埋め込みモデルの実装が求められているのです。

たとえば、FastTextやBERTといった一般的なモデルでも、日本語データの学習に合わせたモデルを使うことで、より精度の高い処理が可能になります。以下で、具体的な日本語埋め込みモデルの実装方法と、その際のポイントを説明していきます。

日本語埋め込みモデルの実装方法

日本語埋め込みモデルの実装には、一般的にPythonのプログラミング言語を用います。Pythonには、自然言語処理(NLP)で広く使われているライブラリが豊富にそろっており、その中でも特にTransformersライブラリやFastTextライブラリは、日本語対応のモデル構築に最適です。

1. ライブラリと日本語データの準備

まず、日本語の埋め込みモデルに対応するために、以下のライブラリとデータセットを準備します。

- Transformersライブラリ:BERTなどの高度な埋め込みモデルを使用するためのライブラリです。

- 日本語データセット:公開されているデータセット、たとえば日本語Wikipediaデータや、一般公開されているニュースデータなどを利用します。

# Transformersライブラリのインストール

!pip install transformers

# 必要なライブラリの読み込み

from transformers import BertModel, BertTokenizer

import torch

2. 日本語特化型BERTモデルのロード

次に、日本語特化型のBERTモデルをロードします。日本語対応のモデルとしては、cl-tohoku/bert-base-japaneseなどがよく利用されます。このモデルは日本語データで学習されているため、日本語特有の表現を捉えやすくなっています。

# 日本語BERTモデルとトークナイザーの読み込み

model_name = 'cl-tohoku/bert-base-japanese'

tokenizer = BertTokenizer.from_pretrained(model_name)

model = BertModel.from_pretrained(model_name)

3. テキストのベクトル化

テキストを埋め込みベクトルに変換するには、テキストをトークナイズし、モデルに入力する必要があります。以下の例では、日本語の文章をベクトルに変換し、その結果を出力します。

# テキストをトークナイズし、埋め込みベクトルを取得

text = "自然言語処理の埋め込みモデルを学ぶ"

tokens = tokenizer(text, return_tensors="pt")

outputs = model(**tokens)

embedding_vector = outputs.last_hidden_state.mean(dim=1)

4. パラメーターの調整

埋め込みモデルの効果を最大化するためには、パラメーターの調整が必要です。例えば、学習率やバッチサイズ、エポック数などを調整することで、モデルの性能が向上します。以下に、主要なパラメーターの例とその役割を示します。

- 学習率 (learning rate):モデルの学習速度を調整します。日本語の文脈をより深く理解させるには、低めの学習率が適しています。

- エポック数:データセット全体を何回繰り返して学習するかを決める回数です。過学習を防ぐために、エポック数を慎重に設定します。

from transformers import Trainer, TrainingArguments

# 訓練パラメーターの設定

training_args = TrainingArguments(

output_dir='./results', # 出力先

num_train_epochs=3, # エポック数

per_device_train_batch_size=8, # バッチサイズ

learning_rate=2e-5, # 学習率

weight_decay=0.01 # 重み減衰

)日本語埋め込みモデルの応用例

日本語に特化した埋め込みモデルは、さまざまなアプリケーションで役立っています。

1. カスタマーサポートでの自動応答

顧客からの問い合わせを分類し、適切な回答を提示するために、埋め込みモデルが使用されます。特にFAQ応答では、類似した質問を自動的に見つけ出し、回答の一貫性を保ちます。

2. SNSでの感情分析

埋め込みモデルは、SNS上の投稿からユーザーの感情を分析する際に役立ちます。特に日本語では、感情表現が多様であるため、埋め込みモデルの活用が効果的です。

3. レコメンドシステム

日本語テキストを埋め込みモデルでベクトル化し、ユーザーの好みに応じた記事や製品の推薦が可能になります。これにより、ユーザー体験が向上し、コンテンツの満足度が高まります。

日本語の埋め込みモデルは、日本語特有の文脈や表現を正確に捉え、自然言語処理の分野で幅広く応用されています。特にカスタマーサポートやSNS分析、レコメンドシステムなどでその効果が発揮されています。日本語埋め込みモデルの実装とパラメーター調整により、より効果的なAIソリューションが構築可能です。

今後も埋め込みモデルの技術は進化し続け、より多様な日本語アプリケーションでの活用が期待されます。

埋め込みモデルのファインチューニング方法:最適なパラメーター調整と実践例

埋め込みモデルを効果的に活用するためには、既存モデルを適切に調整する「ファインチューニング」が重要です。ファインチューニングは、特定の用途やデータセットに合わせてモデルの性能を引き出すために行われる再学習プロセスです。埋め込みモデルのファインチューニングに必要な基本手順と調整ポイントを、実例を交えつつわかりやすく説明します。

埋め込みモデルのファインチューニングとは?

埋め込みモデルのファインチューニングは、既に学習済みのモデル(たとえばBERTやFastTextなど)に対して、新しいデータセットやターゲットタスクに適した知識を追加し、精度を高めるための調整プロセスです。これにより、モデルが特定の課題に対して適切な結果を出せるようになります。

なぜファインチューニングが必要なのか?

埋め込みモデルは膨大なデータで学習されていますが、あくまで一般的な知識を持つだけです。特定の分野や目的に応じて、追加学習を施すことで、特定の文脈に対する理解力が向上し、精度の高い処理が実現します。

埋め込みモデルのファインチューニング方法

埋め込みモデルをファインチューニングするには、以下の手順で進めることが一般的です。

1. 適切なデータセットの準備

ファインチューニングを行うためには、対象となるタスクに合ったデータセットを準備します。たとえば、顧客サポート用のモデルを構築する場合、過去の問い合わせデータを用意すると効果的です。データが豊富であるほど、モデルの学習精度は向上しますが、あまりにもデータ量が多すぎると過学習(オーバーフィッティング)になるため注意が必要です。

2. トークナイザーとモデルの選択

トークナイザーはテキストをトークン(単語やフレーズ)に分割し、数値に変換する役割を持ちます。モデルに適したトークナイザーを選ぶことで、ファインチューニングがスムーズに進みます。

例として、BERTモデルのファインチューニングでは、BERT用のトークナイザーを使うと効率的です。

from transformers import BertTokenizer, BertForSequenceClassification

# モデルとトークナイザーの準備

model_name = 'bert-base-uncased'

tokenizer = BertTokenizer.from_pretrained(model_name)

model = BertForSequenceClassification.from_pretrained(model_name)

3. ハイパーパラメーターの調整

ファインチューニングを行う際、以下のようなハイパーパラメーターを調整することが重要です。

- 学習率(learning rate):モデルの重みを更新する際の速度です。小さな学習率にすることで、より細かい調整が可能になります。

- バッチサイズ:一度に処理するデータの量を示します。大きなバッチサイズは計算速度を上げますが、精度が低下することがあります。

- エポック数:モデルがデータセット全体を学習する回数です。適切なエポック数を設定し、過学習を防ぐことが大切です。

from transformers import TrainingArguments

# ファインチューニングのパラメーター設定

training_args = TrainingArguments(

output_dir='./results',

num_train_epochs=3, # エポック数

per_device_train_batch_size=8, # バッチサイズ

learning_rate=2e-5, # 学習率

)

4. モデルのトレーニング

データとパラメーターが整ったら、実際にモデルのトレーニングを行います。トレーニング中に損失関数(loss)が減少するかを確認し、モデルが適切に学習できているかを監視します。

from transformers import Trainer

# トレーナーのセットアップ

trainer = Trainer(

model=model,

args=training_args,

train_dataset=train_dataset, # 準備したデータセット

eval_dataset=eval_dataset # 評価用データセット

)

# トレーニングの実行

trainer.train()

ファインチューニングの応用例と注意点

応用例:カスタマーサポートの自動化

ファインチューニングされた埋め込みモデルは、カスタマーサポートで活用されています。過去の問い合わせデータを使ってモデルをファインチューニングすることで、新しい問い合わせに対して自動的に適切な回答を提示することが可能です。

応用例:感情分析

SNSやレビューサイトの投稿に対して感情分析を行うために、埋め込みモデルをファインチューニングするケースもあります。特定の感情表現に敏感なモデルを作成することで、ポジティブな意見やネガティブな意見を効率よく分類できます。

注意点:過学習(オーバーフィッティング)のリスク

ファインチューニングは強力な手法ですが、訓練データに適応しすぎると、過学習のリスクが生じます。過学習は、モデルが訓練データには高い精度を示す一方で、新しいデータには対応できなくなる現象です。適切なエポック数を設定し、バリデーションデータを使ってモデルの性能を評価することが重要です。

注意点:ドメインの偏り

ファインチューニングに使用するデータセットが偏っている場合、モデルが特定の内容にのみ反応するようになってしまうことがあります。データセットの多様性を確保し、できるだけ幅広い文脈で学習させるように工夫しましょう。

埋め込みモデルのファインチューニングは、AIモデルの精度とパフォーマンスを向上させるために重要なプロセスです。日本語のテキストデータに特化したファインチューニングを行うことで、特定のビジネスニーズに合わせた高度なNLPソリューションが構築できます。最適なパラメーター調整を行い、過学習に注意しながらトレーニングを進めることで、信頼性の高いモデルが実現できるでしょう。

ファインチューニングにより、AIのパフォーマンスが向上し、さらに広い用途で活用が進んでいくことが期待されます。

埋め込みモデルとは?種類とLLMとの比較で理解する効果的な活用法

埋め込みモデルは、データを数値ベクトル化してコンピュータが言語や画像の意味を理解できるようにするための技術です。最近は大規模言語モデル(LLM)も注目されていますが、埋め込みモデルとは役割や用途が異なります。埋め込みモデルとLLMの違いを明らかにし、どの場面でどちらを使うべきかを比較しながら解説します。

埋め込みモデルの基礎:なぜ必要なのか?

埋め込みモデルとは、テキストや単語を数学的なベクトルに変換する技術であり、文や単語間の類似性を定量化する手段として利用されます。例えば、「犬」と「猫」が類似している言葉であることを、埋め込みモデルはベクトルの距離で表現できます。これにより、検索エンジンやチャットボットの性能が向上し、適切な回答や情報を提供することが可能です。

埋め込みモデルの種類と比較指標

埋め込みモデルにはさまざまな種類があり、用途に応じて選択されます。ここでは主な埋め込みモデルの種類と、比較に用いる指標について解説します。

主な埋め込みモデル

- Word2Vec: 単語を文脈に基づいて埋め込むシンプルなモデル。大規模なデータセットがなくても構築可能で、計算リソースが少なくて済むことが利点です。

- GloVe: Word2Vecに似た手法ですが、単語同士の共起確率を使って単語間の関係を計算します。一般的な語彙の埋め込みに適しており、特定の用途で広く使用されています。

- BERT: Transformerアーキテクチャを基盤としたモデルで、文脈に基づいた単語の意味を理解できることが特徴です。双方向に文脈を捉えるため、より高精度なテキスト分析が可能です。

- FastText: Facebook AI Researchが開発したモデルで、未知の単語に対する対応力が高いことが特徴です。サブワード単位の埋め込みができ、タイポや新語に強いメリットがあります。

比較指標

埋め込みモデルを比較する際には、以下の指標が役立ちます。

- ベクトルの次元数: モデルが生成するベクトルの次元が多いほど、情報量が豊富ですが、計算コストが増します。特定の用途には低次元のモデルが適することもあります。

- 語彙カバレッジ: モデルが対応できる単語の範囲や未知語への対応力です。たとえば、FastTextはサブワード単位での埋め込みを行うため、未知語への対応が強いです。

- 文脈の理解度: 特にBERTのようなTransformerモデルでは、文脈に基づいて単語の意味を解釈するため、文全体の理解度が向上します。対して、Word2VecやGloVeは単語単位の埋め込みなので、文脈の理解度は限定的です。

埋め込みモデルの応用例と選び方

埋め込みモデルは用途に応じて適切なものを選ぶことが重要です。以下に代表的なユースケースと、それに適したモデルを示します。

カスタマーサポートシステム

顧客からの問い合わせ内容を自動分類し、適切な回答を提供する場合、文脈理解が重要になります。そのため、BERTのようなTransformerモデルを使うことで、問い合わせ内容の意味をより正確に把握し、適切な応答が可能です。

検索エンジン最適化(SEO)

SEOにおいては、語彙カバレッジが重視されるため、FastTextやGloVeが適しています。これらは多くの単語を理解でき、未知語にも柔軟に対応するため、検索クエリに対して関連性の高い結果を返すことが可能です。

埋め込みモデルと大規模言語モデル(LLM)の違い

埋め込みモデルとLLM(大規模言語モデル)には、どちらもテキストの理解を高める目的がありますが、そのアプローチには違いがあります。

LLMの特徴とメリット

LLMは巨大なデータセットと多層のニューラルネットワークによって学習されており、文章生成や質問応答のような高度なタスクをこなせます。GPTシリーズなどのモデルがLLMの代表例です。LLMは自然な言語生成が得意であるため、チャットボットやコンテンツ生成に適しています。

埋め込みモデルとの比較

埋め込みモデルは、テキストのベクトル表現を通して意味の類似性や関係を数値的に把握するのに対し、LLMはテキストそのものを生成する能力を持ち、より複雑な言語タスクに対応できます。以下に簡単に両者の違いを示します。

| 特徴 | 埋め込みモデル | 大規模言語モデル(LLM) |

|---|---|---|

| 主な用途 | 意味の類似性や分類 | 文章生成、質問応答 |

| 学習データ規模 | 比較的小規模でも対応可能 | 大規模データが必須 |

| 利用リソース | 比較的少ないリソースで実行可能 | 計算リソースが必要 |

| 文脈理解度 | 一方向(Word2Vecなど) | 双方向(BERTやGPTなど) |

埋め込みモデルは、意味検索や文章の分類など単純なタスクに適している一方、LLMは応答生成や創造的なタスクに向いています。

埋め込みモデルは、NLPにおける基礎技術であり、検索エンジンからサポートシステムまで、さまざまな分野で利用されています。LLMと比較して計算コストが低いため、シンプルなタスクに適しており、用途に応じた選択が重要です。LLMのような高度な言語生成が不要であれば、埋め込みモデルは効果的な選択肢と言えます。

無料で使える埋め込みモデルの活用方法と制約について

自然言語処理(NLP)や機械学習に関心がある方にとって、テキストデータを効率よく扱う埋め込みモデルの活用は欠かせません。しかし、商用の埋め込みモデルは費用がかかり、気軽に試すにはハードルが高いと感じる方も多いでしょう。無料で使用できる埋め込みモデルを紹介し、どのように実装できるかを具体的な例と共に解説します。また、無料モデルの利点と制約についても触れ、導入の際の参考にしていただける内容にしています。

無料の埋め込みモデルとは?代表的な例と使用方法

無料の埋め込みモデルの種類

- Word2Vec(Googleが公開)

- 特徴:シンプルかつ軽量な埋め込みモデルで、単語間の類似性を計算することが得意です。

- 用途:単語のクラスタリングや類似性検索に適しており、幅広いテキストデータの解析に使用できます。

- GloVe(Stanford NLPが公開)

- 特徴:語彙内の共起確率に基づいたモデルで、単語間の関係を数値化することで、文章内の意味を把握します。

- 用途:レビュー分析やカテゴリ分類、感情分析など、文全体の意図を把握する場合に効果的です。

- FastText(Facebook AI Researchが公開)

- 特徴:サブワード単位で埋め込みを行い、未知の単語にも対応可能です。

- 用途:チャットボットやサポートシステムなど、変化の多いテキストデータを扱うアプリケーションで強みを発揮します。

無料の埋め込みモデルのダウンロードと基本的な実装方法

- ダウンロード:Word2VecやGloVeは、それぞれの公式サイトやGitHubページから無料でダウンロード可能です。必要なモデルファイルをダウンロードした後、Pythonのライブラリである

gensimなどを使用して簡単に実装できます。 - 基本的なコード例

from gensim.models import KeyedVectors

# Word2Vecの読み込み例

model = KeyedVectors.load_word2vec_format('GoogleNews-vectors-negative300.bin', binary=True)

# 単語の類似性を調べる

similarity = model.similarity('king', 'queen')

print(f"kingとqueenの類似度: {similarity}")このコードは、Word2Vecを利用して単語間の類似性を算出する基本的な例です。Word2VecやGloVeのような埋め込みモデルを使用すると、簡単にテキスト内の意味的な関連性を解析でき、機械学習プロジェクトの基盤として活用可能です。

無料埋め込みモデルの応用例:実際のビジネス活用

無料の埋め込みモデルを利用することで、コストを抑えつつ効果的な分析が可能です。以下に、具体的な応用例をいくつか紹介します。

レビューの感情分析

EコマースサイトでのレビューやSNSでのフィードバックを分析する際、Word2VecやGloVeを使用することで、ユーザーの肯定的・否定的な感情を分類できます。無料の埋め込みモデルを使ってテキストの類似性を計算し、レビューを「ポジティブ」「ネガティブ」などのカテゴリに分けることが可能です。

サポートチャットボットの改善

FastTextは、新しい単語や言い回しにも対応できるため、カスタマーサポートにおけるチャットボットの精度を向上させるために適しています。ユーザーからの問い合わせ内容を埋め込みベクトルに変換し、類似の問い合わせを見つけることで、適切な回答を返すことができます。

無料の埋め込みモデルを使用する際の制約

無料の埋め込みモデルには、いくつかの制約もあります。これらを理解しておくと、導入の際の判断に役立ちます。

モデルの制約

- 語彙の制約:無料で提供されている埋め込みモデルは、トレーニングデータセットに依存しています。たとえば、Word2VecのGoogleニュースデータセットは2013年以前のニュースに基づいているため、新しい単語や専門用語に対応できないことがあります。

- 文脈の理解度:Word2VecやGloVeは単語の埋め込みに特化しており、文章全体の意味を理解するのには限界があります。例えば、同じ単語でも文脈によって意味が変わる場合には、これらのモデルは十分な精度を発揮できないことがあります。

- モデルのサイズと計算リソース:GloVeやWord2Vecのモデルサイズは大きいため、メモリや処理速度に制約がある場合には注意が必要です。

無料モデルの限界と対策

無料モデルの限界を補う方法としては、独自のデータセットを使ってファインチューニングを行うことが有効です。これにより、特定の分野や用途に適した埋め込みモデルを構築し、より精度の高い結果が得られます。

無料で使用できる埋め込みモデルは、機械学習や自然言語処理の基礎技術として非常に有用です。Word2Vec、GloVe、FastTextといった代表的な無料モデルを活用することで、コストを抑えつつ効果的な分析を行うことができます。一方で、これらのモデルには特定の制約も存在するため、使用する際には目的やデータに合った選択が重要です。

独自のニーズに合わせてモデルをファインチューニングすることで、さらに高い精度で結果を得られる可能性もあります。ビジネス用途や趣味のプロジェクトに活用しやすい無料モデルは、埋め込み技術の効果を実感するための第一歩として最適です。

埋め込みモデルの学習方法を徹底解説

埋め込みモデルは、単語や文章を数値ベクトルに変換し、自然言語処理やデータ分析を容易にするための技術です。モデルを効果的に学習させるには、データの選択やパラメータ設定が重要です。埋め込みモデルの学習方法について、手順や必要なツール、実際の設定例をもとに詳しく紹介します。

埋め込みモデルの学習方法とデータセットの選択

埋め込みモデルとは?

埋め込みモデルは、単語や文をベクトル(数値の配列)に変換する技術で、意味的な類似性や関係性を表現するのに適しています。例えば、Word2VecやGloVeといったモデルが有名で、近年はBERTやGPTといった高度なモデルも登場しています。これらのモデルを学習させることで、文章内の文脈や意味を理解する精度が向上します。

データセットの選び方

埋め込みモデルの学習には、モデルが利用される目的に合わせたデータセットを選ぶことが大切です。以下は、用途別のデータセットの例です:

- 一般的な自然言語処理

- データセット例:WikipediaやCommon Crawl(インターネット上の膨大なテキスト)

- 特徴:幅広い知識をカバーしているため、幅広いテキスト解析が必要な場合に最適です。

- 専門領域の分析

- データセット例:医療用データセット(PubMed、ClinicalTrials)、法務データ(Case Law Corpus)

- 特徴:医療や法務など特定分野の専門知識が求められる場合、業界特有のデータセットを用いると良い結果が得られます。

データの前処理

データセットを選んだら、適切な前処理が重要です。主な前処理方法は次の通りです:

- 正規化:大文字・小文字の統一や不要な記号の削除

- トークン化:単語や文章を分割し、個別のトークンとして扱う

- ストップワードの削除:”the”や”and”など意味に影響を与えにくい単語を除外

埋め込みモデルの学習方法:具体例とパラメーターの調整

埋め込みモデルの構築手順

- ライブラリのインポート

Pythonのgensimライブラリなどを使用して簡単に埋め込みモデルを構築できます。以下はWord2Vecを使用した例です。

from gensim.models import Word2Vec

# サンプルデータ

sentences = [["machine", "learning", "is", "fun"], ["deep", "learning", "is", "powerful"]]

# モデルの構築

model = Word2Vec(sentences, vector_size=100, window=5, min_count=1, workers=4)- パラメーターの調整

埋め込みモデルのパラメーターは、学習の精度やパフォーマンスに大きく影響を与えます。以下は代表的なパラメーターです:

- vector_size:生成されるベクトルの次元数。高次元に設定するほど意味のある関係性を学習できますが、計算負荷も増加します。

- window:周辺の単語数。値が大きいと広い文脈を考慮し、小さいと直近の単語に重みがかかります。

- min_count:出現頻度の低い単語を除外する閾値。一般的に5以下に設定されます。

オンラインサービスを活用した埋め込みモデルの学習

埋め込みモデルの学習には多大なリソースが必要ですが、OpenAIやHugging Faceのようなオンラインサービスを利用することで、手軽に高精度なモデルを扱うことができます。

- OpenAI

OpenAIのAPIを使えば、既に学習済みの埋め込みモデルを利用したり、自社データに基づいてさらにカスタマイズが可能です。APIを呼び出すことで、手軽に埋め込みベクトルを取得できます。 - Hugging Face

Hugging Faceは、埋め込みモデルやトランスフォーマーモデルの多くを無料で提供しています。事前学習済みモデルを使い、目的に合わせてファインチューニングすることで、自社用の高度な埋め込みモデルが構築可能です。

埋め込みモデルの応用例:学習済みモデルの活用法

カスタマーサポートでの問い合わせ分類

カスタマーサポートにおける問い合わせ分類に埋め込みモデルを利用することで、内容に基づいた自動分類が可能になります。例えば、問い合わせの内容を埋め込みベクトルに変換し、類似度計算に基づいてカテゴリ分けを行うことで、迅速な対応が可能になります。

商品推薦システムの精度向上

ECサイトにおける商品推薦でも埋め込みモデルは効果を発揮します。ユーザーが閲覧した商品の説明文やレビューを埋め込みベクトルに変換し、関連性の高い他の商品を推薦することで、購入率の向上が期待できます。

埋め込みモデルの学習には、適切なデータセット選びやパラメーターの設定が欠かせません。また、OpenAIやHugging Faceといったオンラインツールを利用することで、リソース不足に悩むことなく高性能なモデルを構築できます。埋め込みモデルの応用例として、カスタマーサポートや商品推薦など、多岐にわたるビジネス活用が可能です。

これらの知識を活かし、データから意味を引き出す埋め込みモデルを効果的に活用してみてください。

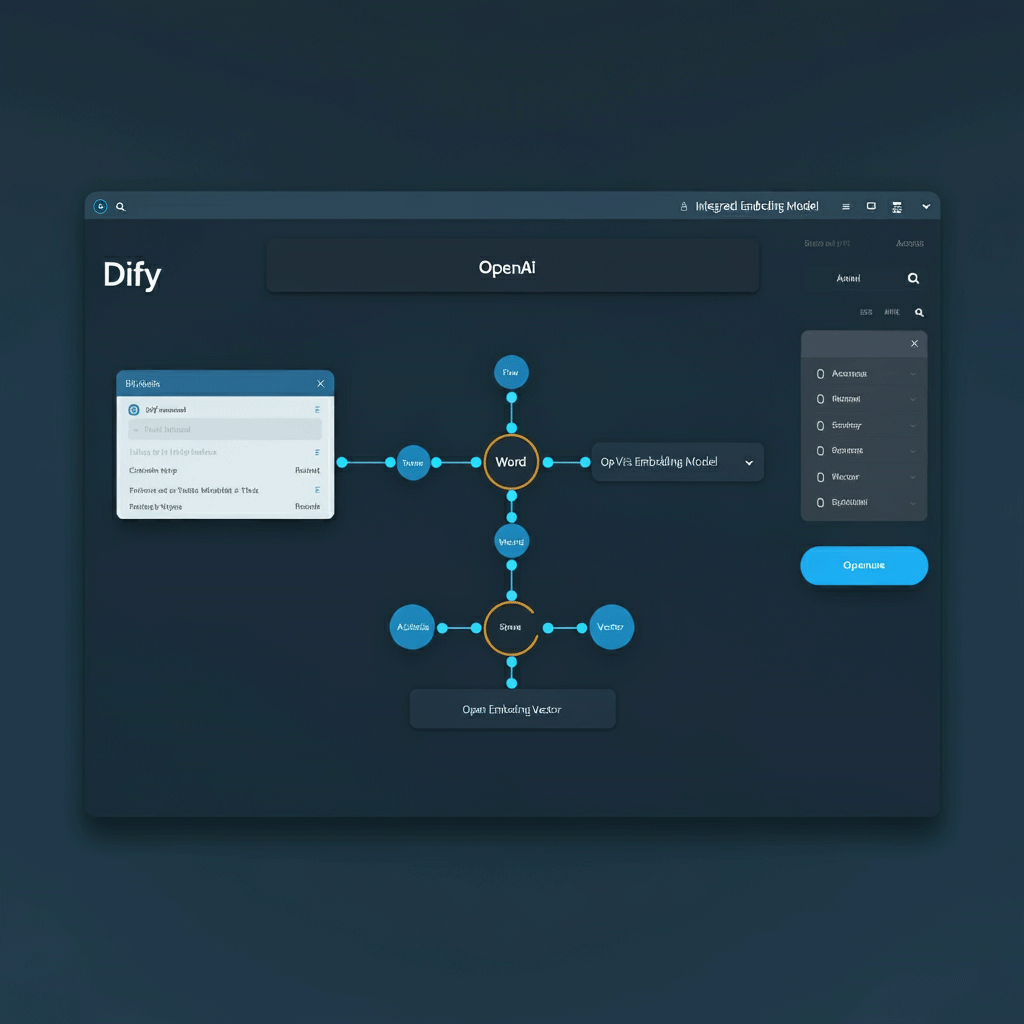

DifyでOpenAIの埋め込みモデルを利用する方法を解説

OpenAIの埋め込みモデルは、テキストデータの解析や検索など、さまざまな用途で活用されていますが、その利用にはプラットフォームのサポートが必要です。Difyは、OpenAIモデルの導入を支援するプラットフォームで、埋め込みモデルの活用をスムーズに実現します。本記事では、Difyを使用したOpenAI埋め込みモデルの導入と実践的な使い方をわかりやすく説明します。

DifyとOpenAIの埋め込みモデルとは?

Difyとは?

Difyは、さまざまなAIモデルやデータパイプラインの統合と管理を簡単にするためのプラットフォームです。専門的な知識がなくても、高度なAI機能を直感的なインターフェースで扱えるため、ビジネスの意思決定やデータ分析のサポートに最適です。

OpenAIの埋め込みモデルとは?

OpenAIが提供する埋め込みモデルは、単語や文章を数値ベクトル(埋め込みベクトル)に変換し、データ間の意味的な関係を分析するのに利用されます。これにより、例えば類似したテキストを検出したり、顧客のレビューを分析したりする際に役立ちます。

DifyとOpenAIの埋め込みモデルを組み合わせることで、埋め込みベクトルの作成から分析までのプロセスが一気に効率化されます。

DifyでOpenAIの埋め込みモデルを利用する方法

1. OpenAIのAPIキーを取得する

まず、DifyからOpenAIの埋め込みモデルを利用するには、OpenAIのAPIキーが必要です。OpenAIの公式サイトに登録し、アカウント設定からAPIキーを生成します。このAPIキーはDifyでOpenAIのモデルにアクセスする際に使用されるため、必ず控えておきましょう。

下記のページでOpenAIのAPIキーの取得方法について解説しています。

2. DifyにOpenAIの埋め込みモデルをインポートする

Difyを使ってOpenAIの埋め込みモデルを利用するための手順は以下の通りです:

- Difyアカウントにログイン:Difyのアカウントにログインし、管理画面にアクセスします。

- プロジェクトの作成:Difyの管理画面で新しいプロジェクトを作成し、埋め込みモデルを使用するプロジェクトに設定します。

- OpenAIのAPIを接続:プロジェクト設定画面から「モデル接続」オプションを選び、OpenAIのAPIキーを入力します。これにより、OpenAIの埋め込みモデルがDify上で使用可能になります。

- モデルのインポート:APIの接続が完了したら、OpenAIの埋め込みモデルをインポートします。Difyの「モデル管理」から、インポートしたい埋め込みモデルを選択し、プロジェクト内で利用可能に設定します。

下記のページでOpenAIのAPIキーをDifyで設定する方法について解説しています。

3. 埋め込みモデルインターフェースの利用

Difyでは、インポートした埋め込みモデルを直感的に操作できるインターフェースが用意されています。このインターフェースを利用することで、以下のような操作が簡単に行えます。

- データのアップロード:分析対象のデータをDifyにアップロードします。例えば、テキストデータやレビューのデータセットを取り込むことで、埋め込みモデルによる解析が可能になります。

- 埋め込みベクトルの生成:アップロードしたデータに対して埋め込みモデルを適用し、各データに対応する埋め込みベクトルを生成します。このベクトルを用いることで、データ間の類似性を数値として表現できます。

- 類似度計算:Difyの埋め込みモデルインターフェースを通じて、生成したベクトル間の類似度を計算し、類似したデータの自動検出や分類に利用できます。

応用例:DifyとOpenAI埋め込みモデルの組み合わせによるメリット

応用例1:カスタマーサポートにおける問い合わせ分析

DifyとOpenAIの埋め込みモデルを活用すれば、カスタマーサポートにおける問い合わせデータを自動分類できます。問い合わせ内容を埋め込みベクトルに変換し、類似度に基づいてカテゴリ別に分類することで、サポート担当者の効率が向上します。

応用例2:マーケティングデータの類似性分析

マーケティング部門での顧客レビュー分析にもDifyと埋め込みモデルは有用です。顧客の声をベクトル化し、共通のパターンや意見を抽出することで、効果的なマーケティング施策の立案が可能です。

応用例3:文書検索エンジンの構築

Difyで生成した埋め込みベクトルを活用することで、文書検索エンジンの構築も簡単になります。DifyとOpenAIの組み合わせにより、キーワードに頼らず、意味に基づいた検索が可能になり、より精度の高い検索結果が得られます。

DifyとOpenAI埋め込みモデルを利用するメリット

- 効率的なワークフロー:Difyの直感的なインターフェースにより、埋め込みモデルの設定や管理が容易であり、専門知識が少ないユーザーでも扱いやすいです。

- 高精度な分析:OpenAIの高性能な埋め込みモデルを使用することで、類似性検出や分類の精度が向上し、実用的な分析結果を得られます。

- スケーラビリティ:Difyはクラウドベースでのモデル利用が可能なため、大量のデータや大規模なプロジェクトにも対応可能です。

DifyでOpenAIの埋め込みモデルを利用することで、データの分類や分析が格段に効率化されます。カスタマーサポートの自動化や顧客データの分析、検索エンジン構築など、多岐にわたるビジネスシーンでの応用が可能です。Difyのシンプルなインターフェースを活用して、埋め込みモデルを簡単に利用し、業務の効率化と精度向上を目指しましょう。